主任医师 博士生导师 硕士生导师

其他任职:大连理工大学附属肿瘤医院副院长,胃外科学科带头人,辽宁省胃肠肿瘤医工交叉应用研究重点实验室主任

性别:男

学位:博士

所在单位:临床医学院

学科:生物医学工程

遗传学

细胞生物学

办公地点:大连理工大学附属肿瘤医院(辽宁省肿瘤医院)

联系方式:

电子邮箱:

赵岩教授邮箱 :

助手邮箱 :

开通时间: ..

最后更新时间:..

发布时间:2026-01-22 点击次数:

01文献学习

由中国医科大学附属肿瘤医院(辽宁省肿瘤医院)胃外科赵岩团队联合北部战区总医院、中国医科大学附属盛京医院、浙江省肿瘤医院等多中心团队近日(2025年12月20日)在《npj Digital Medicine》(中科院1区top,IF=15.1)上发表的研究“Interpretable deep learning for multicenter gastric cancer T staging from CT images”即基于CT图像的可解释深度学习用于多中心胃癌T分期,该研究开发了GTRNet——一种基于CT影像的可解释深度学习框架,用于胃癌T分期。研究采用多中心数据(1792例患者),实现端到端的T1-T4自动分类,无需人工标注。结果显示,模型在内外测试中准确率达81–85%,优于放射科医生,并通过Grad-CAM热图增强可解释性。结合临床特征构建的列线图进一步提升了分期准确性与临床实用性。

创新点:①提出无需手动分割的全自动端到端深度学习框架GTRNet,实现CT图像直接四分类T分期。②引入可解释的Grad-CAM热力图,可视化模型关注区域,提升临床可信度与透明度。③融合深度学习特征与临床病理指标构建联合列线图,实现多模态风险分层。

临床价值:①显著提升胃癌T分期准确性(AUC 0.86–0.95),优于放射科医生,辅助治疗决策。②有效区分T2与T3等临界分期,优化新辅助治疗选择,减少过度或不足治疗。③提供标准化、客观的CT分期工具,降低主观差异,支持多中心临床应用与推广。

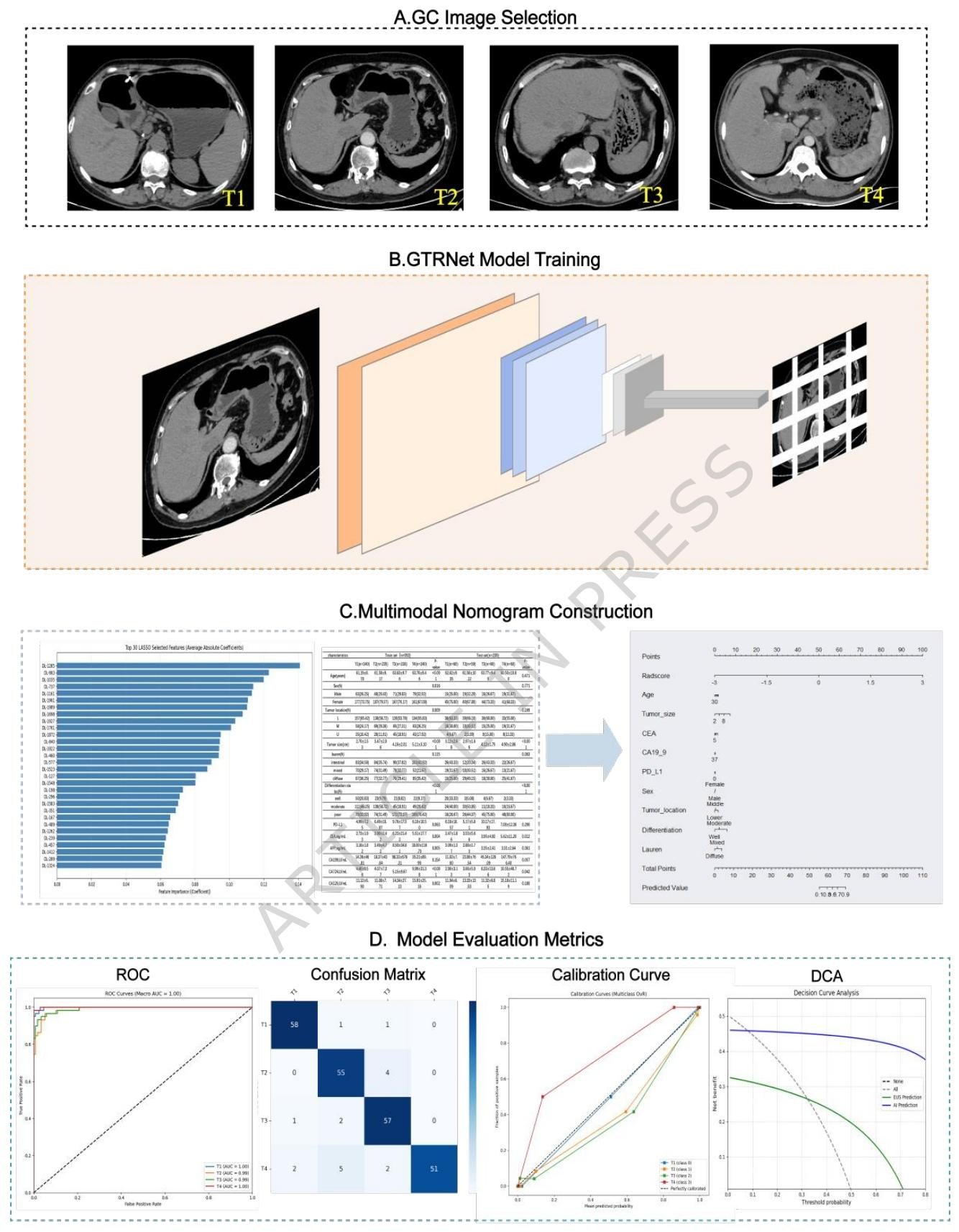

图 6:模型开发流程图

输入层(A):以门静脉期CT的“肿瘤最大横截面切片”为输入,经标准化预处理(无需手动分割肿瘤),简化临床应用流程;

模型层(B):基于改进ResNet-152架构,新增平行池化与中心裁剪分支,同步提取肿瘤局部细节与全局上下文特征,适配T分期浸润深度判断需求;

临床转化层(C):从模型提取深度特征生成Rad-score,结合肿瘤大小、分化程度等临床病理因素,构建可视化列线图,直接输出T1-T4分期概率,辅助临床决策。

02研究背景及目的

研究背景

胃癌是全球范围内重大的健康负担,其术前准确的T分期对于制定个体化治疗方案至关重要,直接影响从内镜切除到多模式治疗等不同干预手段的选择。目前,增强CT是术前评估的主要影像学方法,但其在T分期中的整体准确率仅为65–75%,尤其在区分T2与T3期肿瘤、识别细微浆膜侵犯方面存在显著困难,且解读过程高度依赖医师经验,存在主观性与不一致性。内镜超声虽能清晰显示胃壁层次,有助于早期肿瘤识别,但其在晚期、近端病灶中准确性下降,且操作者依赖性较强,限制了其广泛适用性。近年来,人工智能尤其是深度学习在医学影像分析中展现出强大潜力,已有研究在乳腺癌、肺癌等领域取得突破,然而在胃癌T分期领域,多数现有工作仍局限于“早期与晚期”的二元分类,或依赖耗时且一致性差的手动肿瘤分割,难以实现大规模临床转化。因此,亟需开发一种自动化、高精度且具备临床可解释性的深度学习系统,以弥补当前分期手段的不足,提升胃癌术前评估的客观性与可靠性。

研究目的

本研究旨在开发并验证一种端到端、可解释的深度学习框架——GTRNet,用于基于常规CT影像自动完成胃癌T1–T4四分类分期。该研究主要目标包括:第一,构建一个无需手动分割或标注的全自动分期模型,通过优化后的ResNet-152主干网络提取肿瘤特征,仅使用肿瘤最大轴位切片进行训练,以提升临床工作流程效率;第二,在多个独立外部队列中验证模型的泛化能力与分期性能,比较其与放射科医师在T分期任务中的准确性,并利用Grad-CAM可视化技术增强模型的可解释性,使医师能够直观理解模型决策依据;第三,将深度学习输出的Rad-score与关键临床病理因素(如肿瘤大小、分化程度、Lauren分型)相结合,构建一个整合性列线图,为术前风险分层与辅助治疗决策提供概率化、个体化的工具。通过上述工作,研究期望为胃癌术前T分期提供一种标准化、自动化且临床可信任的AI辅助系统,最终支持更精准的治疗策略制定,减少不必要的治疗干预,改善患者预后。

03数据和方法

研究数据

数据来源:3家中国三级甲等医院2015年1月-2021年12月收治的胃癌患者(中国医科大学附属肿瘤医院、北部战区总医院、浙江省肿瘤医院)。

样本量:共纳入1792例经病理证实的胃腺癌患者,分组如下:

训练集:953例(来自医院A)

内部测试集:239例(来自医院A)

外部测试集1:360例(来自医院B)

外部测试集2:240例(来自医院C)

金标准:以术后病理T分期(pT)作为诊断金标准,用于模型训练与性能验证。

技术方法

数据预处理:CT图像统一重采样至1×1×1mm³体素,标准化HU范围(-1024~1024),采用腹部窗设置(WL 50,WW 350),无需手动分割肿瘤区域,仅选取最大肿瘤横截面的轴向切片(224×224像素)用于训练。

模型训练策略:训练阶段采用数据增强(随机旋转、翻转、强度调整)、迁移学习(ResNet-152预训练权重初始化)、自适应早停机制(避免过拟合);外部测试时采用“关键切片+上下相邻切片”的三切片多数投票策略,降低单切片预测随机性。

性能评估:采用多分类评价指标(宏平均AUC、准确率、灵敏度、特异度、PPV、NPV),通过ROC曲线、混淆矩阵分析;与3家医院8-15年经验的消化科放射科医生进行盲法对比试验,评估AI辅助诊断的提升效果;采用决策曲线分析(DCA)、校准曲线验证临床实用性。

可解释性与临床整合:通过Grad-CAM生成热力图可视化模型关注区域;构建整合深度学习Rad-score与肿瘤大小、分化程度、Lauren分型的列线图,实现概率化T分期预测。

核心技术方法

端到端深度学习框架GTRNet:基于改进的ResNet-152骨干网络,新增并行最大池化与中心裁剪流,同时捕捉肿瘤局部细节与胃壁周围上下文信息;无需手动标注或分割,直接输入CT切片即可输出T1-T4四分类结果,适配临床workflow。

可解释性增强:利用Grad-CAM热力图定位模型决策关键区域(如T1期聚焦胃壁内层、T4期聚焦肿瘤与邻近器官界面),与放射科医生关注的解剖结构高度重合(Dice系数0.56~0.63),解决AI“黑箱”问题。

临床整合模型:将深度学习特征转化为Rad-score,结合临床病理危险因素(肿瘤大小≥5cm、低分化、弥漫型Lauren分型)构建列线图,其净临床获益显著高于传统EUS分期,过度治疗率(2.09%)与治疗不足率(2.51%)显著降低。

04实验结果

模型性能:

内部测试集准确率89.9%,外部测试集准确率86.7–93.6%。

AUC范围为0.91–0.98,显著高于放射科医生(58.4–59.7%)。

可解释性:

Grad-CAM热力图显示模型关注区域与病理侵犯区域高度一致(Dice系数0.56–0.63)。

临床辅助:

结合Rad-score、肿瘤大小、分化程度与Lauren分型的列线图具有良好的校准能力。

决策曲线分析显示模型在多数阈值范围内净临床效益高于EUS。

医生辅助效果:

AI辅助下放射科医生诊断准确性提升至85.4–91.5%,Kappa值从0.41–0.45提升至0.83–0.88。

05研究结论

本研究开发了一种名为GTRNet的可解释端到端深度学习框架,用于基于CT图像的胃癌T分期,在无需人工标注或分割的情况下,实现了T1-T4四分类的高精度自动分期。研究回顾性纳入了1792例多中心患者数据,结果显示GTRNet在内部测试集和两个外部验证集中均表现出优异的判别性能,准确率达81–85%,AUC为0.86–0.95,显著优于放射科医师的独立诊断(准确率约55–60%)。通过Grad-CAM热图可视化,模型能够聚焦于胃壁及浆膜等关键解剖区域,展现出良好的可解释性与临床一致性。进一步,结合深度学习放射组学评分与肿瘤大小、分化程度及Lauren分型构建的列线图,在决策曲线分析中显示出比传统内镜超声更高的净临床收益,且过度治疗与治疗不足率均显著降低。尽管该研究在推广至国际人群及不可手术晚期病例方面存在一定局限,但其结果表明GTRNet具备标准化CT分期、辅助术前决策及优化新辅助治疗选择的潜力,为胃癌精准诊疗提供了可靠的AI支持工具。

06局限性与未来展望

局限性:①合并T4a与T4b分期分析,未纳入部分晚期不可手术病例,可能导致模型在复杂临床场景中适用性受限。②外部验证仅基于中国人群,缺乏国际多中心数据支撑,难以直接推广至全球不同人群与扫描协议。③未涵盖N、M分期,仅聚焦T分期,未能形成完整TNM分期辅助工具,诊断覆盖不够全面。

未来展望:①采用Transformer或3D CNN架构,挖掘多层面图像上下文信息,进一步提升模型特征提取能力与预测精准度。②整合影像、基因组学等多组学数据,构建患者特异性数字孪生系统,强化个性化诊疗决策支持。③扩展至完整TNM分期,开展国际多中心前瞻性研究,验证模型在不同场景下的稳定性与普适性。

参考文献:Zheng G, Wang H, Chai X, Xin X, Li F, Li H, Ban Y, Wang J, Qi X, Li Y, Yan Z, Guo F, Jiang Z, Zhu D, Zhang Y, Zheng Z, Zhang X, Zhang J, Zhao Y. Interpretable deep learning for multicenter gastric cancer T staging from CT images. NPJ Digit Med. 2025 Dec 20. doi: 10.1038/s41746-025-02002-5.